Як відрізняти відео, створене штучним інтелектом, від справжнього?

Уявіть: ви відкриваєте стрічку — і бачите ролик, де знайомий політик оголошує щось шокуюче. Під відео – тисячі коментарів, хтось уже панікує, хтось радіє. Перший імпульс – негайно переслати друзям.

Але є одна проблема: цього звернення ніколи не було.

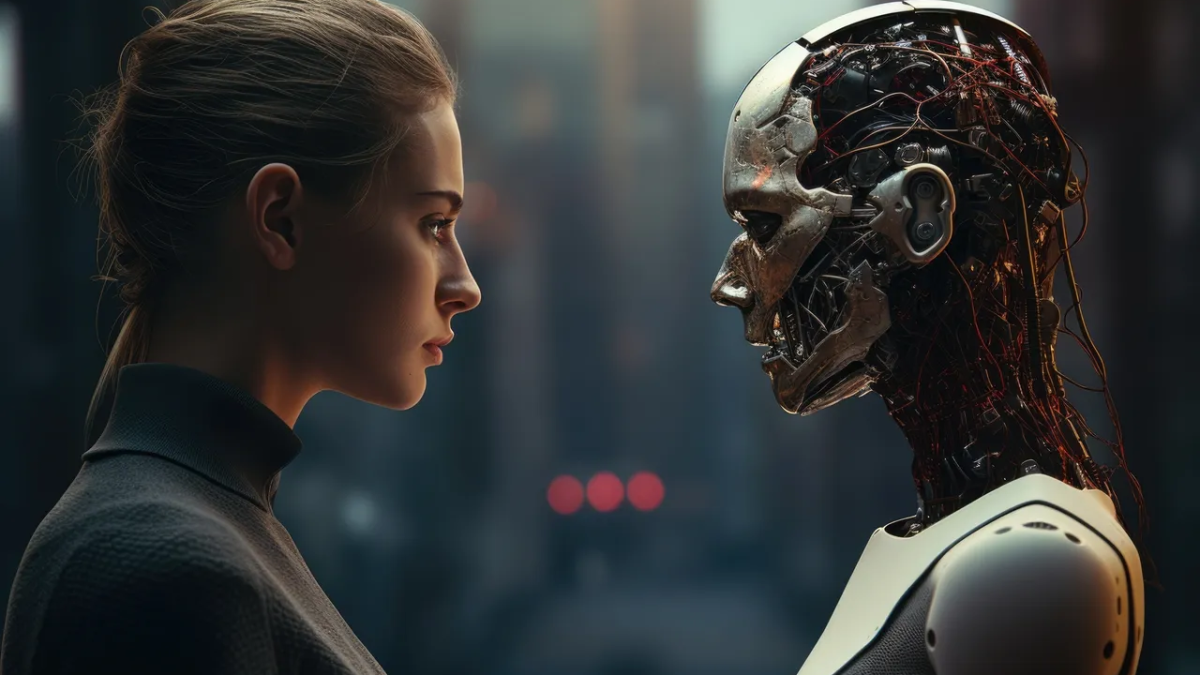

Штучний інтелект навчився створювати відео, які все важче відрізнити від реальності. Deepfake, згенеровані обличчя й голоси, цілі “новини”, яких не існувало – все це вже не кіно, а наша щоденна стрічка.

Цей текст — не технічна інструкція, а

Чому ми більше не можемо просто “довіряти очам”

Раніше фейк впізнавали за грубим монтажем, карикатурною графікою чи дивним озвученням.

Тепер достатньо кількох хвилин нейромережі — й у вас “справжнє” відео президента, який каже те, чого ніколи не говорив.

Головна зміна:

завдання глядача — не “одразу впізнати підробку”, а вчасно засумніватися й перевірити.

Особливо, якщо відео тисне на емоції: лякає, принижує, змушує ненавидіти або кликати “терміново переказати гроші”.

Обличчя, яке видає алгоритм

Найчастіше штучний інтелект “спотикається” на деталях. Якщо придивитися, з’являються дрібні, але дуже показові збої.

Ось кілька відеостворені штучним інтелектом:

Очі

- майже не моргають або роблять це ривками;

- погляд ніби “плаває”, не фокусується на предметах;

- відблиск в очах постійний і неприродний, ніби намальований.

Рот

- губи не завжди точно збігаються зі звуком;

- зуби виглядають як суцільна біла смуга без чітких контурів;

- лінія рота може трохи “дрижати” або провалюватися в шкіру.

Контури обличчя

- лінія щелепи, вух, лоба часом змінюється від кадру до кадру;

- на стику шиї й обличчя видно дивні тіні або легкий “ореол”, ніби маска.

Вам не потрібно вміти пояснити, що саме не так. Досить відчути: “виглядає дивно” — і не брати це відео на віру.

Голос, який звучить надто ідеально

Голос теж навчилися копіювати. Але у живої людини він ніколи не ідеальний.

Штучно згенерований голос часто:

- звучить рівно, майже без природних коливань інтонації;

- робить підозріло “правильні” паузи, ніби читає текст із суфлера;

- має легкий “пластиковий” або металевий відтінок;

- сміх, крики, сильні емоції звучать дивно, ніби наклеєні поверх.

Ще одна дрібниця: синхрон. Якщо губи говорять “сьогодні”, а звук “завтра” запізнюється навіть на частку секунди — це вже причина насторожитися.

Руки, фон, тіні: де штучний світ дає збій

Алгоритмам усе ще складно з фізикою світу.

Звертайте увагу на:

- руки – дивна форма пальців, їх надто багато, вони зливаються, кільця “гуляють” по руці;

- рух тіла – плечі, шия, голова рухаються ніби не зовсім злагоджено;

- фон – текст на плакатах, вивісках, номерах автомобілів виглядає як каша з букв, логотипи спотворені;

- світло й тіні – тінь від людини не відповідає напрямку світла, відбиття в дзеркалі або вікні “живе своїм життям”.

Це те, що можна помітити, якщо хоча б раз сповільнити перегляд і подивитися не тільки на слова, а й на зображення.

Хто це виклав і чому саме тут?

Перед тим як роздивлятися пікселі, варто поставити просте запитання:

а хто взагалі опублікував це відео?

Журналісти завжди починають із джерел. Такий самий підхід варто застосувати й у соцмережах.

Перевірте:

- скільки існує цей акаунт;

- чи є в нього історія: старі пости, різні теми, нормальні коментарі;

- чи не виглядає профіль як щойно створений “спеціально під цю сенсацію”.

Важливі звернення політиків, мерів, великих компаній ніколи не з’являються лише в одному випадковому Telegram-каналі чи TikTok-акаунті без підтвердження в офіційних джерелах.

Якщо “бомбове відео” живе тільки в одному анонімному каналі – це сильний сигнал зупинитися.

Де підтвердження? Перехресна перевірка

Ще один принцип журналістики, який працює і для простого глядача:

не віримо одному джерелу, шукаємо інші.

Що можна зробити:

- виписати ключову фразу з відео й пошукати її в Google;

- перевірити офіційні сайти, сторінки органів влади, відомі медіа;

- звернути увагу на дату: іноді старе відео видають за сьогоднішнє.

Якщо ролик обіцяє “сенсацію”, але жодне нормальне видання її не підтверджує, — краще поставитися до відео як до недостовірного.

Зворотній пошук та інші прості трюки

Навіть без спецосвіти можна зробити кілька простих кроків.

Скріншот + пошук по картинці.

Зробіть стоп-кадр із відео, де добре видно обличчя або важливий момент, і завантажте його в пошук зображень. Часто так виявляється, що “сьогоднішнє” відео — насправді уривок із давнього сюжету з іншим контекстом.

Спеціальні детектори deepfake.

Існують сервіси, які аналізують відео й намагаються виявити сліди генерації ШІ. Вони помиляються, але можуть стати ще одним аргументом “за” чи “проти” довіри.

Головне — сприймати їх як додаткову думку, а не як “машину істини”.

Навіщо взагалі комусь витрачати час на такі підробки?

Штучні відео — не іграшка. Вони вже стали інструментом атак.

Політичні маніпуляції

Підроблені звернення лідерів:

нібито “здача міста”, “заклик скласти зброю”, “оголошення капітуляції”.

Мета — посіяти паніку, зламати мораль, викликати недовіру до своїх.

Фінансові схеми

“Авторитетний бізнесмен”, блогер чи чиновник на відео просить:

“Терміново інвестуйте”, “пройдіть за посиланням”, “перекажіть на цей рахунок”.

Мета — витягнути максимум грошей, поки людина в шоці й не встигає думати.

Шантаж і атаки на близьких

ШІ вміє відтворювати голос:

“Мамо, я в біді, мені терміново потрібні гроші” — і на іншому кінці слухавки нібито ваш син або донька.

Або фейкове відео, яке нібито компрометує людину, з погрозою: “заплати, інакше опублікуємо”.

Що робити, якщо відео виглядає підозрілим

- Не пересилати й не коментувати “на емоціях”.

Навіть обурений репост допомагає фейку розлетітися. - Зберегти посилання й скріншоти.

Можуть знадобитися, якщо ви звернетеся до фактчекерів чи адміністрації платформи. - Перевірити офіційні джерела.

Якщо мова про політику, війну, гроші — без цього кроку краще взагалі не робити висновків. - Пояснити рідним.

Особливо старшим, які менше знайомі з такими технологіями. Одна коротка розмова іноді рятує від великих проблем. - Поскаржитися на контент на платформі.

Це виглядає дрібницею, але скарги користувачів часто вирішують, скільки людей ще побачать цей ролик.

Короткий чеклист глядача

Перш ніж повірити відео, поставте собі кілька запитань:

- Хто це оприлюднив і чи довіряю я цьому каналу?

- Чи є підтвердження в інших, незалежних джерелах?

- Чи не поводяться підозріло обличчя, руки, фон, тіні?

- Чи звучить голос природно?

- Чи логічно, що така заява з’явилася саме тут і саме так?

- Які емоції це викликає — і чи не намагаються через них мною маніпулювати?

Штучний інтелект стає дедалі переконливішим. Але в нього досі немає того, що є у вас: критичного мислення, відчуття контексту й життєвого досвіду.